CEO Nvidia: EU tụt hậu xa so với Mỹ và Trung Quốc về đầu tư AI

Thế giới số - Ngày đăng : 18:07, 23/10/2024

CEO Nvidia: EU tụt hậu xa so với Mỹ và Trung Quốc về đầu tư AI

Liên minh châu Âu (EU) tụt hậu xa so với Mỹ và Trung Quốc về đầu tư vào trí tuệ nhân tạo (AI), Jensen Huang - Giám đốc điều hành Nvidia cho biết hôm 23.10.

Dù chỉ có một số ít công ty AI ở châu Âu, chẳng hạn Mistral (Pháp) và Aleph Alpha (Đức), khối này đã thông qua các quy tắc toàn diện đầu tiên trên thế giới để quản lý AI, có hiệu lực vào tháng 8.

"EU phải đẩy nhanh tiến độ trong AI. Mọi nước đều thức tỉnh khi nhận ra rằng dữ liệu là nguồn tài nguyên quốc gia", Jensen Huang nói trong chuyến thăm Copenhagen (thủ đô Đan Mạch).

Jensen Huang đến Đan Mạch để ra mắt siêu máy tính mới có tên Gefion, sở hữu 1.528 bộ xử lý đồ họa (GPU), được Nvidia xây dựng bởi sự hợp tác với Novo Nordisk Foundation và Export and Investment Fund của Đan Mạch.

Novo Nordisk Foundation là tổ chức phi lợi nhuận quốc tế, được biết đến là một trong những quỹ từ thiện giàu có nhất thế giới. Quỹ này có nguồn gốc từ công ty dược phẩm Novo Nordisk, nổi tiếng với các sản phẩm điều trị bệnh tiểu đường.

Export and Investment Fund là tổ chức tài chính độc lập thuộc sở hữu của chính phủ Đan Mạch. Quỹ này có vai trò quan trọng trong việc thúc đẩy hoạt động kinh doanh của các công ty Đan Mạch trên thị trường quốc tế, đặc biệt là ở những nước đang phát triển và các thị trường mới nổi.

Nvidia (Mỹ) là công ty hàng đầu thế giới về GPU, vốn có nhu cầu cao vì được sử dụng để tăng tốc công việc AI. Ví dụ, mô hình ngôn ngữ lớn GPT của OpenAI được đào tạo bằng siêu máy tính có hàng chục ngàn GPU Nvidia.

Đan Mạch có kế hoạch sử dụng siêu máy tính này để khám phá thuốc, chẩn đoán bệnh, điều trị và các thách thức khoa học sự sống phức tạp.

"Kỷ nguyên khám phá thuốc với máy tính hỗ trợ phải diễn ra trong thập kỷ này. Đây sẽ là thập kỷ của sinh học kỹ thuật số", Jensen Huang cho biết.

Nvidia hiện là công ty có vốn hóa thị trường lớn thế hai thế giới (3.520 tỉ USD), chỉ đứng sau Apple (3.590 USD).

Quy mô nhỏ hơn Colossus rất nhiều

Cần nói thêm rằng Gefion (sở hữu 1.528 GPU Nvidia) có quy mô nhỏ hơn rất nhiều so với siêu máy tính Colossus của xAI dù mục đích sử dụng khác nhau.

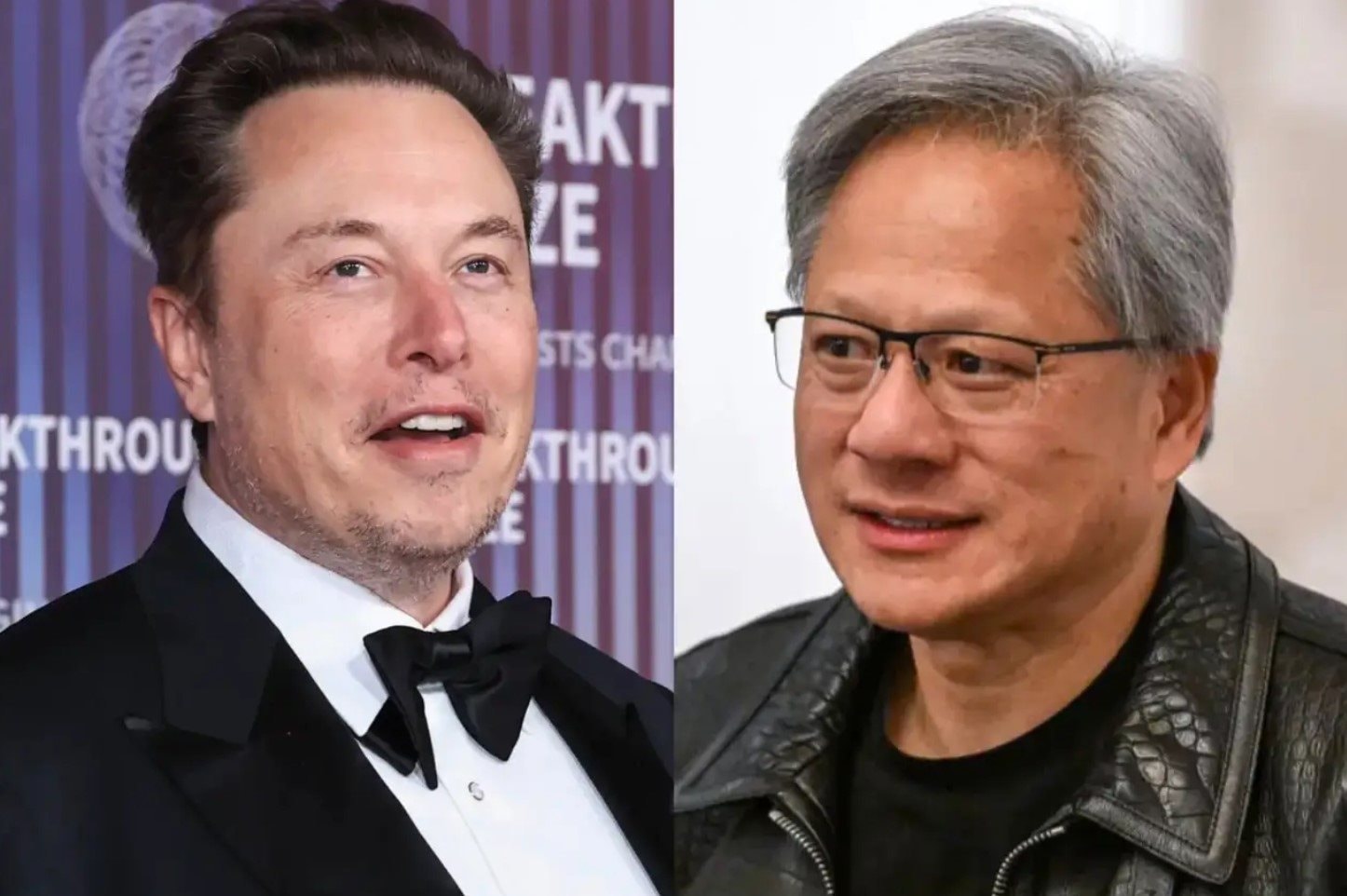

Là công ty AI ở Mỹ do Elon Musk điều hành, xAI xây dựng siêu máy tính có tên Colossus, từ một cụm gồm 100.000 GPU Nvidia H100. Elon Musk tuyên bố Colossus đại diện cho "hệ thống đào tạo AI mạnh mẽ nhất thế giới".

Gần đây, Jensen Huang ca ngợi Elon Musk sau khi xAI xây dựng siêu máy tính này trong 19 ngày, một nỗ lực mà Giám đốc điều hành Nvidia cho biết đáng ra sẽ mất nhiều năm.

Trong tập podcast Bg2 Pod phát sóng hôm 13.10, Jensen Huang nhấn mạnh rằng đó là nỗ lực "siêu phàm" của Elon Musk để xây dựng siêu máy tính AI ở thành phố Memphis (bang Tennessee, Mỹ) trong khoảng thời gian ngắn như vậy.

Giám đốc điều hành Nvidia cho biết: "Theo như tôi biết, chỉ một người trên thế giới có thể làm được điều đó. Elon là người duy nhất hiểu biết về kỹ thuật, xây dựng, hệ thống lớn và huy động tài nguyên. Thật không thể tin được".

Hồi tháng 9, Elon Musk cho biết trong một bài đăng trên X rằng phải mất 122 ngày "từ đầu đến cuối" để đưa cụm đào tạo AI trực tuyến, ám chỉ đến tổng thời gian của dự án, và sẽ "tăng gấp đôi quy mô" (lên 200.000 GPU) trong vài tháng khi có thêm nhiều GPU hơn.

Jensen Huang khen ngợi các nhóm kỹ thuật, phần mềm, mạng và cơ sở hạ tầng của xAI và gọi họ là "phi thường".

Trong cuộc phỏng vấn với Jordan Peterson trên X hồi tháng 6, Elon Musk tiết lộ mất 19 ngày để đưa Colossus từ cài đặt phần cứng đến khi bắt đầu đào tạo AI.

Jordan Peterson là nhà tâm lý học lâm sàng, triết gia chính trị, giáo sư tâm lý học nổi tiếng người Canada. Ông được biết đến rộng rãi qua những quan điểm của mình về các vấn đề xã hội, văn hóa, và tâm lý học.

Jensen Huang bình luận về Colossus: "Để dễ hình dung, 100.000 GPU đó dễ dàng là siêu máy tính nhanh nhất trên hành tinh khi xét theo một cụm. Một siêu máy tính mà bạn xây dựng thường mất 3 năm để lên kế hoạch, sau đó họ giao thiết bị và mất 1 năm để đưa mọi thứ vào hoạt động".

Ra mắt năm 2023, xAI đã phát hành phiên bản mới nhất chatbot AI Grok-2 vào tháng 8. Hồi tháng 5, xAI thông báo đã huy động được 6 tỉ USD trong vòng gọi vốn mới.

Larry Ellison, nhà đồng sáng lập và Chủ tịch hãng Oracle, kể vào tháng 9 rằng ông đã dùng bữa tối với Elon Musk và Jensen Huang tại thành phố Palo Alto (bang California, Mỹ), nơi hai người bạn lâu năm "cầu xin" Giám đốc điều hành Nvidia cung cấp thêm GPU.

Larry Ellison kể họ nói với Jensen Huang: "Xin hãy lấy tiền của chúng tôi. Chúng tôi cần anh lấy thêm tiền của chúng tôi" trước khi bông đùa rằng: "Mọi việc diễn ra ổn thỏa, thành công".

Việc đưa Colossus trực tuyến đánh dấu một bước quan trọng cho tham vọng AI của Elon Musk, đặc biệt là có thể bắt kịp đối thủ ở Thung lũng Silicon là Mark Zuckerberg.

Tham vọng của Mark Zuckerberg và Elon Musk phụ thuộc vào GPU hiệu suất cao, cung cấp sức mạnh tính toán cần thiết cho các mô hình AI mạnh mẽ. Trong trường hợp của Elon Musk là biến xAI thành một công ty thúc đẩy "sự hiểu biết chung của chúng ta về vũ trụ" với Grok.

Những GPU Nvidia không thực sự dễ kiếm và cũng không hề rẻ.

Sự cường điệu được tạo ra xung quanh AI kể từ khi ChatGPT ra mắt vào cuối năm 2022 đã khiến các công ty phải tranh giành GPU Nvidia, với tình trạng thiếu hụt bắt nguồn từ nhu cầu lớn và hạn chế về nguồn cung. Trong một số trường hợp, H100 được bán với giá lên tới hơn 40.000 USD (gần 1 tỉ đồng).

Các công ty đã tìm cách đảm bảo nguồn cung GPU Nvidia theo bất kỳ cách nào có thể và đưa chúng vào hoạt động để vượt lên trước đối thủ bất chấp những rào cản tiếp cận chúng.

Nathan Benaich, người sáng lập kiêm đối tác chung của hãng Air Street Capital, đã theo dõi số lượng Nvidia H100 được các hãng công nghệ mua lại. Ông ước tính tổng số Nvidia H100 mà Meta Platforms hiện có là 350.000, còn xAI là 100.000. Tesla, một trong những công ty khác của Elon Musk, hiện có 35.000 Nvidia H100.

Microsoft, OpenAI và Amazon chưa tiết lộ quy mô của các kho dự trữ H100 của họ.

Meta Platforms chưa tiết lộ chính xác Mark Zuckerberg có được bao nhiêu GPU từ mục tiêu 600.000 của mình và bao nhiêu GPU đã được đưa vào sử dụng. Song trong một bài báo nghiên cứu được công bố vào tháng 7, công ty mẹ Facebook cho biết phiên bản lớn nhất của mô hình ngôn ngữ lớn Llama 3 đã được đào tạo trên 16.000 Nvidia H100.

Hồi tháng 3, Meta Platforms công bố "một khoản đầu tư lớn vào tương lai AI của công ty" với hai cụm 24.000 GPU để hỗ trợ phát triển Llama 3.

Cụm đào tạo AI mới nhất của xAI, với 100.000 GPU Nvidia H100, lớn hơn nhiều so với cụm được sử dụng để đào tạo Llama 3.

Thành tích của Elon Musk thu hút sự chú ý trong làng công nghệ. Một bài đăng trên X từ tài khoản trung tâm dữ liệu của Nvidia để phản hồi Elon Musk: "Thật thú vị khi thấy Colossus, siêu máy tính GPU lớn nhất thế giới, hoạt động trực tuyến trong thời gian kỷ lục".

Greg Yang, đồng sáng lập xAI, có phản ứng sống động hơn với tin tức này bằng trích đoạn lời bài hát của rapper Tyga (Mỹ).

Shaun Maguire, đối tác tại công ty đầu tư mạo hiểm Sequoia, viết trên X rằng đội ngũ xAI hiện "có quyền tiếp cận cụm đào tạo AI mạnh mẽ nhất thế giới" để xây dựng phiên bản tiếp theo của chatbot Grok. Ông nói thêm: "Grok-2 đã tăng tốc để ngang bằng với các mô hình tiên tiến nhất".

Song giống hầu hết các công ty AI, vẫn còn nhiều dấu hỏi lớn về việc thương mại hóa công nghệ này.

"Thật ấn tượng khi xAI có thể huy động được nhiều tiền như vậy với Elon Musk và đạt được tiến triển, nhưng chiến lược sản phẩm của họ vẫn chưa rõ ràng", Nathan Benaich nói với trang Insider.

Hồi tháng 7, Elon Musk cho biết phiên bản tiếp theo của Grok (sau khi đào tạo trên 100.000 Nvidia H100) "sẽ thực sự là một thứ gì đó đặc biệt".

Lỗi thiết kế của Nvidia với các chip AI Blackwell đã được khắc phục

Hôm 23.10, Jensen Huang nói một lỗi thiết kế trong các chip AI Blackwell mới nhất của hãng, gây ảnh hưởng đến quá trình sản xuất, đã được khắc phục với sự trợ giúp từ đối tác lâu năm là TSMC (Đài Loan). TSMC là hãng sản xuất chip theo hợp đồng số 1 thế giới.

Nvidia giới thiệu các chip Blackwell vào tháng 3 và trước đó nói rằng chúng sẽ được bán ra trong quý 2/2024, nhưng đã bị trì hoãn. Điều này có khả năng ảnh hưởng đến các khách hàng như Meta Platforms, Google và Microsoft.

"Chúng tôi đã gặp lỗi thiết kế trong Blackwell. Nó vẫn hoạt động, nhưng lỗi thiết kế đã khiến tỷ lệ thành phẩm bị thấp. Đó hoàn toàn là lỗi của Nvidia", tỷ phú 61 tuổi người Mỹ gốc Đài Loan nói.

Truyền thông loan tin "sự trì hoãn này gây ra căng thẳng giữa Nvidia và TSMC", nhưng Jensen Huang bác bỏ điều đó và gọi đây là "tin giả".

"Để làm cho một máy tính Blackwell hoạt động, 7 loại chip khác nhau đã được thiết kế từ đầu và phải được đưa vào sản xuất cùng lúc. Những gì TSMC đã làm là giúp chúng tôi khắc phục vấn đề về tỷ lệ thành phẩm và nối lại việc sản xuất Blackwell một cách tuyệt vời", ông nói.

Các chip Blackwell sử dụng hai tấm silicon có kích thước gấp đôi sản phẩm trước đó của Nvidia và kết hợp chúng thành một thành phần duy nhất, nhanh gấp 30 lần trong các nhiệm vụ như cung cấp câu trả lời từ các chatbot.

Tại hội nghị gần đây của ngân hàng đầu tư đa quốc gia Goldman Sachs (Mỹ), Jensen Huang nói rằng các chip Blackwell sẽ được bán ra vào quý 4/2024.