Cách đây 5 năm, Facebook cung cấp cho người dùng 5 cách mới để phản ứng với một bài đăng ngoài biểu tượng thích, gồm yêu thích, haha, wow, buồn và tức giận (phẫn nộ). Đằng sau hậu trường, Facebook đã lập trình thuật toán quyết định những gì mọi người nhìn thấy trong news feed của họ để phản ứng với biểu tượng cảm xúc làm tín hiệu đẩy nội dung khiêu khích và xúc động hơn, bao gồm cả nội dung có khả năng khiến họ tức giận.

Bắt đầu từ năm 2017, thuật toán xếp hạng của Facebook đã coi phản ứng với biểu tượng cảm xúc có giá trị gấp 5 lần so với lượt thích, các tài liệu nội bộ tiết lộ.

Lý thuyết rất đơn giản: Các bài đăng có nhiều phản ứng với biểu tượng cảm xúc có xu hướng thu hút người dùng hơn và giữ người dùng tương tác là chìa khóa cho hoạt động kinh doanh của Facebook.

Các nhà nghiên cứu của Facebook đã nhanh chóng phát hiện một lỗ hổng nghiêm trọng. Việc ủng hộ các bài đăng “gây tranh cãi” - bao gồm cả những bài khiến người dùng tức giận - có thể vô tình mở ra “cánh cửa dẫn đến nhiều spam/ lạm dụng/clickbait (mồi nhử nhấp chuột) hơn”, một nhân viên Facebook viết trong trong các tài liệu nội bộ. Một đồng nghiệp đã trả lời: "Điều đó có thể".

Các nhà khoa học dữ liệu của Facebook đã xác nhận vào năm 2019 rằng các bài đăng gây ra phản ứng với biểu tượng cảm xúc tức giận có khả năng bao gồm thông tin sai lệch, độc hại và tin tức chất lượng thấp.

Điều đó có nghĩa là Facebook trong 3 năm đã cải tiến một cách có hệ thống một số điểm kém nhất của nền tảng của mình, làm cho nó trở nên nổi bật hơn trong news feed của người dùng và phổ biến nó đến nhiều đối tượng hơn. Sức mạnh của quảng cáo bằng thuật toán đã làm suy yếu nỗ lực của những người kiểm duyệt nội dung và nhóm liêm chính Facebook, những người đang chiến đấu với cuộc chiến cam go chống lại nội dung độc hại và có hại.

Cuộc tranh luận nội bộ về biểu tượng cảm xúc tức giận và những phát hiện về tác dụng của nó đã làm sáng tỏ những đánh giá chủ quan của con người làm nền tảng cho thuật toán news feed Facebook - phần mềm học máy byzantine quyết định cho hàng tỉ người loại bài đăng mà họ sẽ thấy mỗi lần mở ứng dụng.

Thông tin này được tiết lộ với Ủy ban Chứng khoán và Giao dịch Mỹ rồi cung cấp cho Quốc hội dưới hình thức biên soạn lại bởi cố vấn pháp lý của người tố giác Facebook - Frances Haugen. Các phiên bản biên tập lại đã được một nhóm các tổ chức tin tức, bao gồm cả tờ The Washington Post, xem xét.

Frances Haugen phát biểu trước Quốc hội Anh hôm 25.10: “Tức giận và căm ghét là cách dễ dàng nhất để phát triển trên Facebook”.

Trong một số trường hợp, các tài liệu cho thấy các nhân viên của Facebook trong các nhóm “liêm chính” của mình đang giơ cao cờ về giá trị con người thuộc các yếu tố cụ thể của hệ thống xếp hạng - những cảnh báo mà các lãnh đạo công ty đôi khi chú ý và những lần khác dường như gạt sang một bên.

Các nhân viên đã đánh giá và tranh luận về tầm quan trọng của sự tức giận trong xã hội. Tức giận là “cảm xúc cốt lõi của con người”, một nhân viên viết. Trong khi một nhân viên khác chỉ ra rằng các bài đăng gây tức giận có thể là điều cần thiết để phản đối các phong trào chống lại các chế độ tham nhũng.

Người phát ngôn của Facebook - Dani Lever cho biết: “Chúng tôi tiếp tục làm việc để hiểu những gì tạo ra trải nghiệm nội dung tiêu cực, vì vậy chúng tôi có thể giảm sự phân phối của nó. Ví dụ nội dung có số lượng phản ứng giận dữ không cân xứng".

Sức nặng của phản ứng tức giận chỉ là một trong nhiều đòn bẩy mà các kỹ sư của Facebook sử dụng để định hình luồng thông tin và cuộc trò chuyện trên mạng xã hội lớn nhất thế giới. Đó là một trong những đòn bẩy đã được chứng minh là ảnh hưởng đến mọi thứ, từ cảm xúc của người dùng đến các chiến dịch chính trị và hành động tàn bạo.

Facebook tính đến nhiều yếu tố - một số yếu tố có trọng số để tính nhiều, một số tính ít và một số yếu tố được tính là âm – dẫn đến thuật toán hiển thị bài đăng trong news feed của từng người dùng mỗi khi họ làm mới nó.

Thuật toán đó được sử dụng để sắp xếp các bài đăng, quyết định bài nào xuất hiện ở trên cùng và bài nào ở phía dưới mà bạn có thể sẽ không bao giờ nhìn thấy. Hệ thống tính điểm tổng hợp duy nhất đó được sử dụng để phân loại và sắp xếp các hoạt động tương tác giữa con người với nhau ở gần như mọi quốc gia trên thế giới, bằng hơn 100 ngôn ngữ.

Facebook không công bố các giá trị mà thuật toán của họ đặt ra với các loại tương tác khác nhau, chứ chưa nói đến hơn 10.000 “tín hiệu” mà Facebook cho biết phần mềm của họ có thể tính đến khi dự đoán khả năng tạo ra các hình thức tương tác của mỗi bài đăng.

Các đòn bẩy của Facebook dựa vào các tín hiệu mà hầu hết người dùng sẽ không nhận thấy, chẳng hạn như thời lượng nhận xét mà một bài đăng tạo ra, video có phát trực tiếp hay được ghi lại hay không, các nhận xét được đưa ra bằng văn bản thuần túy hay bằng hình đại diện hoạt hình. Nó thậm chí còn tính đến tải trọng tính toán mà mỗi bài đăng yêu cầu và cường độ tín hiệu internet của người dùng.

Tùy thuộc vào đòn bẩy, tác động của ngay cả một chỉnh sửa nhỏ cũng có thể lan truyền khắp mạng, định hình xem các nguồn tin tức trong news feeds của bạn có uy tín hay sơ sài, mang tính chính trị hay không, dù bạn đã nhìn thấy nhiều bạn bè thực sự của mình hay nhiều bài đăng hơn từ các nhóm muốn tham gia, hoặc nếu những gì bạn thấy có thể sẽ khiến bản thân tức giận, khó chịu hoặc truyền cảm hứng cho mình.

Ngoài cuộc tranh luận về biểu tượng cảm xúc tức giận, các tài liệu bị rò rỉ cho thấy các nhân viên Facebook phải vật lộn với những câu hỏi hóc búa về giá trị của công ty, thực hiện các phân tích được xây dựng một cách khéo léo. Khi nhận thấy rằng thuật toán đang làm trầm trọng thêm tác hại, họ đã ủng hộ cho những chỉnh sửa có thể giúp ích. Thế nhưng, những đề xuất đó đôi khi bị lãnh đạo Facebook bác bỏ.

Khi các phần mềm tăng cường, chẳng hạn như các phần mềm dành cho biểu tượng cảm xúc, bị va chạm với các "phần mềm cấm" hoặc "phần giới thiệu" nhằm hạn chế nội dung có thể gây hại, tất cả những phép toán phức tạp đó đã tạo thành một vấn đề trong việc bảo vệ người dùng. Theo các tài liệu, bài viết trung bình có số điểm khoảng vài trăm. Song vào năm 2019, một nhà khoa học dữ liệu của Facebook đã phát hiện ra rằng không có giới hạn về mức độ cao của điểm xếp hạng.

Nếu các thuật toán của Facebook cho rằng một bài đăng không tốt, mạng xã hội này có thể giảm một nửa số điểm của nó, đẩy hầu hết các bài đăng xuống dưới news feed của người dùng. Thế nhưng, một số bài đăng có thể đạt điểm cao tới cả tỉ. Dù cắt giảm một nửa điểm số nhằm giảm hạng thì bài viết đó vẫn sẽ còn lại điểm đủ cao để xuất hiện ở đầu news feed của người dùng.

Văn hóa thử nghiệm đã phát triển sâu rộng tại Facebook, khi các kỹ sư kéo đòn bẩy và đo lường kết quả. Một thử nghiệm vào năm 2014 đã tìm cách thao túng giá trị cảm xúc của các bài đăng được hiển thị trong news feed của người dùng theo hướng tích cực hơn hoặc tiêu cực hơn, sau đó theo dõi xem liệu các bài có thay đổi để phù hợp hay không, gây ra lo ngại về đạo đức.

Một biện pháp khác, được Frances Haugen báo cáo với Quốc hội Mỹ vào tháng này, liên quan đến việc tắt các biện pháp an toàn cho một nhóm nhỏ người dùng để so sánh xem chúng có hiệu quả hay không.

Một nhóm thí nghiệm chưa được báo cáo trước đây liên quan đến việc thúc đẩy một số người tham gia vào news feed của những người bạn được chọn ngẫu nhiên của họ nhiều hơn, và sau khi thử nghiệm kết thúc, kiểm tra xem cặp bạn bè có tiếp tục giao tiếp hay không. Một nhà nghiên cứu đã đưa ra giả thuyết rằng, Facebook có thể khiến các mối quan hệ trở nên thân thiết hơn.

Vào năm 2017, Facebook đã cố gắng đảo ngược sự sụt giảm đáng lo ngại về lượng người đăng bài và trò chuyện với nhau trên trang web; các biểu tượng cảm xúc đã mang lại cho nó 5 đòn bẩy mới để kéo.

Mỗi lần nhấp vào biểu tượng cảm xúc có giá trị bằng 5 lượt thích vào thời điểm đó. Logic là một phản ứng với biểu tượng cảm xúc báo hiệu bài đăng đã gây ấn tượng cảm xúc lớn hơn một lượt thích. Chọn biểu tượng cảm xúc đã tiến thêm một bước ngoài một lần nhấp nút thích.

Thế nhưng, Facebook đã tỏ ra đồng tình với công chúng về tầm quan trọng của họ với những phản ứng này. Công ty nói với trang Mashable vào năm 2017 rằng họ chỉ coi trọng chúng “nhiều hơn một chút so với lượt thích”.

Động thái này phù hợp với một khuôn mẫu, được nêu rõ trong các tài liệu, trong đó Facebook đặt trọng số rất cao về các tính năng mới mà họ đang cố gắng khuyến khích người dùng áp dụng.

Bằng cách đào tạo thuật toán để tối ưu hóa cho các tính năng đó, các kỹ sư của Facebook đều đảm bảo rằng chúng sẽ được mọi người sử dụng và nhìn thấy rộng rãi. Không chỉ vậy, bất kỳ ai đăng bài trên Facebook với hy vọng tiếp cận được nhiều đối tượng, bao gồm các nhà xuất bản và các chính trị gia, chắc chắn sẽ nhận ra rằng một số loại bài đăng hoạt động tốt hơn những loại bài khác.

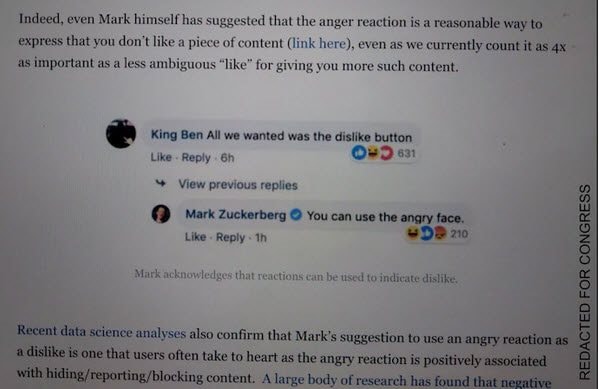

Có thời điểm Giám đốc điều hành Facebook - Mark Zuckerberg thậm chí còn khuyến khích người dùng phản ứng tức giận để báo hiệu rằng họ không thích điều gì đó, dù việc này sẽ khiến Facebook hiển thị nội dung tương tự thường xuyên hơn.

Các câu trả lời cho một bài đăng, báo hiệu một nỗ lực lớn hơn một lần nhấp vào nút phản ứng, thậm chí còn cao hơn, gấp 30 lần một lượt thích.

Facebook nhận thấy rằng sự tương tác từ bạn bè của người dùng trên trang web sẽ tạo ra một loại chu trình lành mạnh thúc đẩy người dùng đăng nhiều hơn. Tờ Wall Street Journal đã báo cáo vào tháng trước về cách Facebook chú trọng nhiều hơn vào nhận xét, trả lời nhận xét và trả lời chia sẻ lại - một phần của chỉ số được gọi là "tương tác xã hội có ý nghĩa" - khuyến khích hơn nữa các bài đăng chính trị gây chia rẽ. Bài báo đó cũng đề cập đến sức nặng ban đầu với biểu tượng cảm xúc tức giận dù không phải là các cuộc tranh luận sau đó về tác động của nó.

Mục tiêu của chỉ số này là "cải thiện trải nghiệm của mọi người bằng cách ưu tiên các bài đăng truyền cảm hứng cho các tương tác, đặc biệt là các cuộc trò chuyện, giữa gia đình và bạn bè", Dani Lever nói.

Lần hạ cấp đầu tiên với trọng số biểu tượng cảm xúc tức giận là vào năm 2018, khi Facebook cắt giảm tỷ lệ này xuống còn 4 lần, giữ nguyên trọng lượng cho tất cả các cảm xúc.

Song rõ ràng là không phải tất cả các phản ứng với cảm xúc đều giống nhau. Tức giận là phản ứng ít được sử dụng nhất trong số 6 biểu tượng cảm xúc với 429 triệu lượt nhấp mỗi tuần, so với 63 tỉ lượt thích và 11 tỉ lượt chọn yêu thích, theo một tài liệu năm 2020.

Các nhà khoa học dữ liệu của Facebook phát hiện ra rằng các phản ứng tức giận “thường xuyên hơn nhiều” với các bài đăng có vấn đề: “Tin tức chất lượng thấp của công dân, thông tin sai về công dân, thông tin sai về sức khỏe và nội dung phản đối sức khỏe”, theo một tài liệu từ năm 2019. Nghiên cứu đó cho thấy phản ứng tức giận "bị vũ khí hóa" bởi các chính trị gia.

Vào tháng 4.2019, Facebook đã đưa ra một cơ chế để "giảm hạng" nội dung đang nhận được phản ứng giận dữ không tương xứng, dù các tài liệu không nói rõ cách thức hoặc vị trí mà nội dung đó được sử dụng hay tác dụng của nó.

Đến tháng 7.2019, một đề xuất bắt đầu được đưa ra nhằm cắt giảm giá trị của một số phản ứng với biểu tượng cảm xúc xuống tương đương với một lượt thích, hoặc thậm chí tính chúng không có gì.

Phản ứng tức giận, cùng với wow và haha xảy ra thường xuyên hơn với nội dung độc hại và thông tin sai lệch. Trong một đề xuất khác, từ cuối năm 2019, yêu thích và buồn sẽ có giá trị 4 lượt thích vì chúng an toàn hơn, theo các tài liệu.

Đề xuất phụ thuộc vào việc các cấp cao hơn của Facebook “thoải mái với nguyên tắc về các giá trị khác nhau cho các kiểu phản ứng khác nhau”, các tài liệu cho biết. Nhân viên Facebook nói đây sẽ là cách khắc phục dễ dàng với “ít lo ngại về chính sách hơn” so với một nỗ lực đầy thách thức về mặt kỹ thuật để xác định các bình luận độc hại. Song vào phút cuối, đề xuất mở rộng các biện pháp đó trên toàn thế giới đã bị loại bỏ.

Một nhân viên sau đó đã viết: “Tiếng nói của sự thận trọng đã chiến thắng khi không cố gắng phân biệt các kiểu phản ứng khác nhau và do đó là những cảm xúc khác nhau”.

Cuối năm đó, như một phần của cuộc tranh luận về cách điều chỉnh thuật toán để ngừng khuếch đại nội dung có thể phá vỡ các chuẩn mực dân chủ, đề xuất coi trọng các phản ứng với biểu tượng cảm xúc tức giận ít hơn một lần nữa lại được đưa ra. Một nhân viên khác đã đề xuất loại bỏ hoàn toàn nút này, nhưng một lần nữa, các trọng số vẫn được giữ nguyên.

Cuối cùng, năm ngoái, “trận lũ bằng chứng đã làm vỡ đập”. Nghiên cứu bổ sung đã phát hiện ra rằng người dùng luôn không thích khi bài đăng của họ nhận được phản ứng tức giận, dù từ bạn bè hay những người ngẫu nhiên, theo các tài liệu. Facebook đã cắt giảm trọng lượng của tất cả các phản ứng xuống một lần rưỡi so với một lượt thích.

Tháng 9.2020, Facebook cuối cùng đã ngừng sử dụng phản ứng tức giận như một tín hiệu về những gì người dùng muốn và cắt giảm trọng lượng của nó xuống 0, đưa nó ra khỏi phương trình, đồng thời thúc đẩy yêu thích và buồn đáng giá 2 lượt thích.

Đó là một phần của quá trình tinh chỉnh tín hiệu rộng hơn. Ví dụ, các nhận xét có một ký tự sẽ không còn được tính. Cho đến khi thay đổi đó được thực hiện, một nhận xét “có” hoặc “.”, chiến thuật thường được sử dụng để thao túng và xuất hiện cao hơn trong news feeds, được tính gấp 15 lần giá trị của một lượt thích.

“Giống như bất kỳ sự tối ưu hóa nào, sẽ có một số cách mà nó bị khai thác hoặc bị lợi dụng. Đó là lý do tại sao chúng tôi có một nhóm liêm chính đang cố gắng theo dõi những vấn đề đó và tìm ra cách giảm thiểu chúng hiệu quả nhất có thể”, Lars Backstrom, Phó chủ tịch kỹ thuật của Facebook, cho biết.

Hết lần này đến lần khác, Facebook đã điều chỉnh trọng số sau khi chúng gây hại. Facebook muốn khuyến khích người dùng phát video trực tiếp, điều mà họ ưa thích hơn các bài đăng ảnh và văn bản, vì vậy trọng lượng của nó có thể tăng gấp 600 lần.

Điều đó đã giúp gây ra “tính lan truyền cực nhanh cho một số video chất lượng thấp”, một tài liệu cho biết. Các video phát trực tiếp trên Facebook đóng một vai trò quan trọng trong các sự kiện chính trị, bao gồm cả các cuộc biểu tình đòi công lý chủng tộc vào năm ngoái sau khi George Floyd bị giết và bạo loạn tại Điện Capitol (Mỹ) vào ngày 6.1.2021.

Ngay sau cuộc bạo động, Facebook đã điên cuồng ban hành các biện pháp “đập vỡ kính” dựa trên những nỗ lực an toàn mà họ đã hoàn tác trước đó - bao gồm cả giới hạn trọng lượng video trực tiếp chỉ ở mức 60.

Các nhà khoa học dữ liệu của công ty phát hiện ra rằng khi Facebook cuối cùng đã đặt mức độ phản ứng tức giận bằng 0, người dùng bắt đầu nhận được ít thông tin sai lệch hơn, ít nội dung "gây phiền nhiễu" hơn và ít "bạo lực đồ họa" hơn. Hóa ra, sau nhiều năm bị chỉ trích và phản đối, rốt cuộc không có sự trả giá nào. Theo một trong những tài liệu, mức độ hoạt động của người dùng trên Facebook không bị ảnh hưởng.